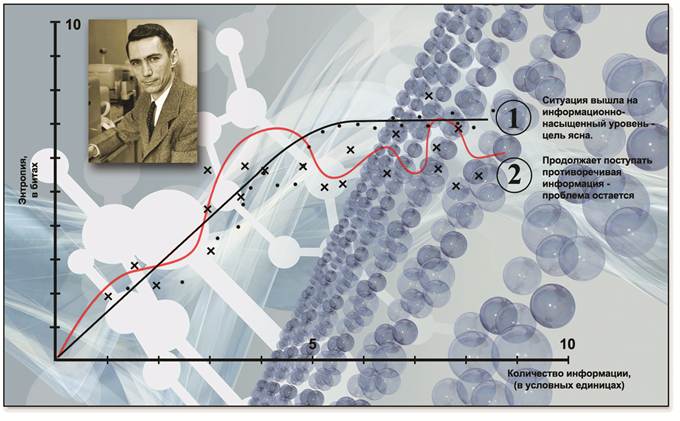

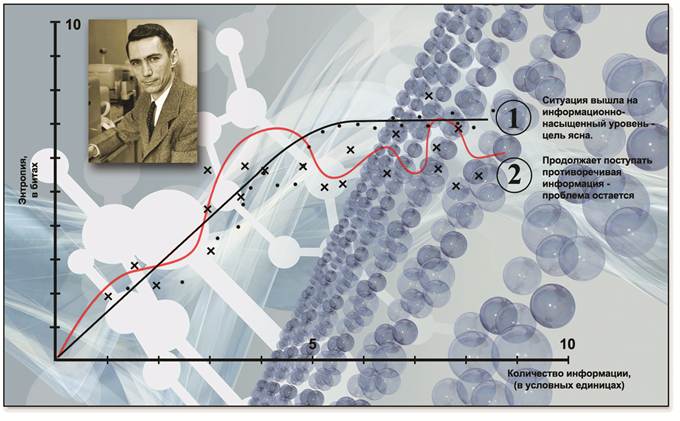

Оценка тех или иных событий – политических, экономических

и других по мере накопления информации

Начало

При создании информационных систем, а таковыми в известной степени являются альбомы, отражающие различные стороны исследуемого объекта, большого и малого, важнейшим является объемность, достоверность и законченность используемой информации в различных видах.

Оценка тех или иных событий – политических, экономических

и других по мере накопления информации

В теории информации есть важнейшее понятие – энтропия, на котором основаны многие информационные законы. Энтропию придумал в годы Второй Мировой войны американский инженер-дешифровальщик Клод Шеннон, с помощью которой он успешно расшифровывал немецкие коды.

Одним из важнейших свойств энтропии является то, что с ее помощью можно оценивать многие ситуации, в том числе политические, экономические и, самое важное, можно показать их динамическую характеристику. Энтропия также показывает необходимое количество информации для принятия решения по той или иной проблеме.

При выполнении данной работы автор использовал огромный массив информации, и все приведенные в альбоме цифры, графики, карты, фотографии и высказывания находятся на информационной асимптоте, что позволяет делать окончательные выводы. Приведены многочисленные убедительные факты, касающиеся различных аспектов из жизни Азербайджана и, как говорил второй Президент США Джон Адамс: «Facts are stubborn things» – «Факты – упрямая вещь».

Информационная насыщенность представленных материалов, их временная динамика и разнонаправленность позволяют близко познакомиться со страной Азербайджан в историческом, политическом, экономическом и др. аспектах, что и было целью автора.